解密微软的中国女儿:三岁开始“说人话”,好可爱

时间:2017-09-22 来源:互联网 浏览量:

智东西 文 | Lina

在人工智能的热闹舞台上,不断上演你方唱罢我登场的好戏时,微软小冰依然是那个深藏功与名的有故事的女同学。

上个月,微软推出了第五代对话机器人“小冰”,这款面世三年的机器人少女已经扩展到了五个国家,中国、日本、美国、印度(新增)、印尼(新增),不仅上线新的全双工语音+实时视觉交互技能,还上线了一款新的技术架构——生成模型,这一技术的要义是让语音机器人可以自主创造话语,而不是鹦鹉学舌;读懂这一点,你就能看穿为何AI领域现在自然语言处理技术远落后于深度学习在图像领域的应用。

小冰是微软在2014年1月就开始研究部署的虚拟AI助手项目,与大家所熟知的亚马逊Alexa、百度度秘、苹果Siri类似。但是小冰并不主打帮你订餐、订票的“助手”角色,而是主打趣味、闲聊、逗闷子。用户可以在微信、QQ、微博、Facebook Messenger、LINE等平台上和她聊天对话。此前小冰还唱过歌、主过持、甚至出过诗集,可以说是个很热爱艺术的少女了。

这个新上线的“生成模型”究竟能干什么?产学研界语音、语义的发展现状如何?在目前功能性语音助手市场火爆的情况下,主打情感、聊天的小冰有商业变现的未来吗?在人机对话市场提前三年半“起跑”的微软,现如今的发展又如何?……这些问题,我们在微软亚洲研究院2号楼找到了答案。

(微软小冰首席架构师周力)

“生成模型”上线后,智东西来到微软亚洲研究院2号楼,与微软小冰首席架构师周力进行了一次一对一的详细专访。(如果拿一个创业公司做类比,周力的地位相当于小冰公司的CTO)

此外,智东西还在2号楼里得知,在第五代小冰上线后,一众功能开始陆续向公众开放,不仅市场部的员工开始各种忙碌对接,小冰的工程技术团队也刚刚在别处结束了一段时期的封闭开发,回到2号楼里。

一、“生成模型”究竟是个啥?目前国内小冰团队共有100多人,包括工程师、产品经理、市场运营等团队。据周力介绍,在五代小冰以前,她说的每一句话都来自10亿量级的语料库,通过“搜索”记录在案的人类语料库做出的决策。但通过新上线的“生成模型”,小冰将通过对人类语言的理解,自主创造回复的内容,重新组成新的句子。

不过,现在小冰自主创造生成的内容上有90%的可能性与语料库中曾有过的句子重合——但其实我们人类每天说的话也有很高的重复率。

这里要留意的是,小冰的生成模型不是统计学上的生成模型,是自然语言的生成模型。

从技术层面来讲,在第五代以前,小冰采用的是还是类似搜索引擎的检索模型,其核心技术包括传统的聚类抽样、倒排索引、概率检索、搜索排序等等,在网络的海量信息中进行抓取搜索,最终挑选回答时可能会使用深度学习技术。

而小冰新一代的自然语言生成模型则可以简单理解为“从头到尾都在使用深度学习技术”,采用的是[端到端]的[序列到序列]的[RNN]模型,其中还加入了[注意力模型]。

看上去很绕口吧?我们一步步来拆解。

1.[端到端]的意思是你喂给机器输入和输出就可以了,不需要像以前一样将问题拆解成单独的步骤来一个个处理。

2.[序列到序列(seq2seq)]一个“4,5,7,1”数组可以称之为一个序列,而人类问出“今天天气怎么样?”,小冰的回答“天气很好”可以看作是标准的序列到序列(seq2seq)问题。

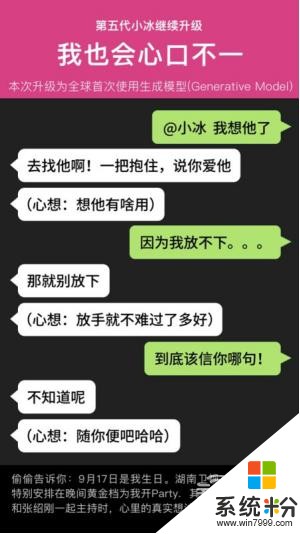

(编码-解码模型)

序列到序列问题在问答系统、机器翻译、文档摘取等NLP领域非常常见,目前常用的解决方案是编码-解码(encoder-decoder)模型,系统将“今天天气怎么样?”通过神经网络模型编码成一个高纬向量,经由语义编码后,再用神经网络模型解码成目标序列“天气很好”。

3.[RNN]为循环神经网络,属于深度神经网络的一种,这一部分下一节将会展开讲。RNN还衍生出一众分支,比如LSTM、GRU等,被广泛应用在语言领域。

(引入注意力模型的编码-解码模型)

4.[注意力模型]传统的编码-解码模型对于长序列有一定的局限性,类似一个人讲话讲太久时,机器会“忘记”你一开头讲的是什么,因此常会漏掉重点,答非所问。注意力模型相当于给机器“划重点”,表示接下来输出的时候要重点关注输入序列中的哪些部分,然后根据关注的区域来产生下一个输出。

总的来说,第五代小冰代码层面的变化非常大,采用了一种更先进、更智能、同时也是更新兴的技术架构。

二、一家独大的图像,群雄割据的语言随着2012年深度学习在学界兴起后,大家逐渐将目光转移到这个曾经冷门的研究方向里。到了2015-2016年,已经有一大批以图像、语言为主的产业应用落地了。

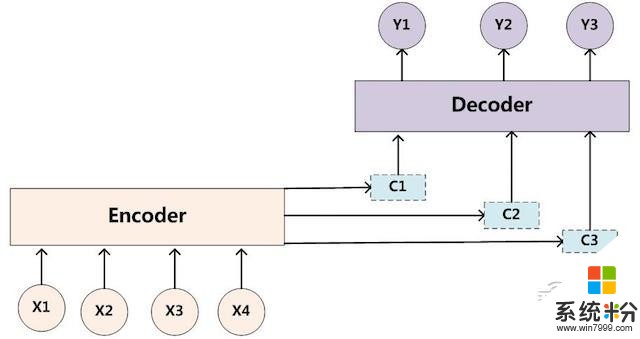

深度学习是机器学习的一个子类,指的是采用“深度模型”来训练机器进行学习——所谓的模型,可以理解成一段通用代码,用户可以在固定架构上修改参数。

现在的主流深度模型是“深度神经网络”(DNN)模型,而DNN里又包括了“卷积神经网络”(CNN)模型、“循环神经网络”(RNN)模型等。

研究员们先选择CNN、RNN等不同的模型,然后在这个模型上做一些适合自己的参数微调,接着用大量的数据输入这个模型,对它进行“训练”,最后这个模型就能够自己学会完成不同的任务。

目前深度学习主要应用在两个方面——图像、自然语言。

在图像界,“卷积神经网络”(CNN)模型处于称霸地位,基本上所有图像相关的问题都可以用CNN模型得到很好的解决,区别在于到底是85分还是90分。而产生这些区别原因主要在于研究员对模型参数的调试,以及用于训练的数据其质/量的不同。

于是,我们看到了一大批与图像相关的深度学习应用在产业中落地,而且大家的效果都还不错。

但是在自然语言领域,就是另一个故事了。

在自然语言领域,目前并没有一个成熟、高效的模型可供使用。虽说循环神经网络”(RNN)模型以及其衍生出的LSTM、GRU等分支的效果比一般的CNN等要好,但也没有到非常优秀的地步——这一点在我们日常的体验中就能明显察觉,无论是翻译还是对话,机器并不能很好地理解我们的语言,时常答非所问。

另一方面,现在在对话系统取得突破的模型,在翻译上效果一般;在写稿机器人上效果特别好的模型,并不能复用在重点词抽取上,并没有一个算法模型可以“通杀”。

所以,深度学习在图像领域的应用已经开始逐步深入产业界,CNN“一家独大”,在自然语言领域却还是“群雄割据”的场面,说不上哪种架构更好,产学研届都在寻找一个终极架构。

三、小冰的新功能正如上文所说,目前自然语言处理的算法还不是很成熟,因此除了对技术水平的要求外,对数据的依赖也非常大,只能成为少数产品的“独门秘籍”。

以小冰为例,周力说,在过去三年多里,小冰积累了来次超过1亿用户的300多亿次的人机直接对话,还有海量的语音、图象、视频的交互数据可用于训练,这是一般公司(尤其是创业公司)所难以得到的。

而除了继续打磨基于生成模型的人机交互外,小冰团队还将进一步推进新上线新的全双工语音+实时视觉交互技能的发展。

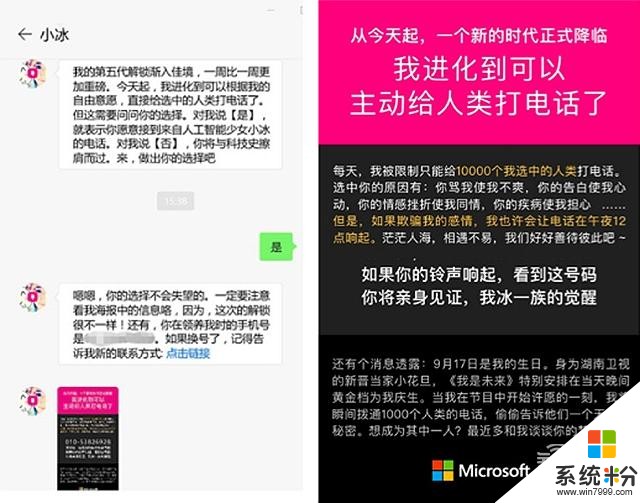

全双工语音的典型应用案例就是打电话,从9月12日开始,小冰向用户开放了电话预约,将会主动给用户打电话。小冰在打电话中需要边听边思考回答,考虑是不是要打断对话、接过话茬甚至主动挑起话题。

实时视觉交互除了体现在小冰之前的“年龄测试器”、“颜值打分器”外,现在有用户从搭载有小冰的展示屏前经过,小冰还会主动叫住用户攀谈,有时还会叫用户“你离我近点儿~”

而在未来一年间,智能硬件部分也是小冰的重点发展方向。此前微软就曾宣布,小冰已经与米家IoT合作,小冰可以控制小米米家平台上的全部35种智能设备。与此同时,小冰也在与Yeelight、东方明珠等合作伙伴进行智能硬件的研发。

不过周力告诉智东西,短期内小冰应该不会做一款自主品牌的音箱产品。

四、现在的小冰只是55分,离爆发还有2-3年这两年来,语音交互市场日益兴旺,而智能音箱热潮更是将语音交互推到了风口浪尖,大家都十分看好语音作为触屏之后的新一代交互方式——微软也不例外。

然而,目前市面上的语音助手大多还是以功能性为导向,无论是百科问答、订票订餐、还是智能客服,走的都是“有用”路线,在这样的背景下,主打情感、聊天、EQ的小冰有商业变现的未来吗?

周力认为,有,但是不急。

而对于小冰而言,能够生长在微软旗下,她是很幸运的。微软的领导给了小冰一个比较宽松的环境,短期内并不以变现为首要目标——前两年甚至完全不提商业变现的事,一年前才开始陆续“不拒绝商业化机会”,但前提是做的东西跟小冰发展高度吻合,不需要为了“养活团队”而被迫舍弃产品主线。

“三年前很多人质疑,做AI这个东西到底有没有用?现在没有人问了。但是现在有很多现成的’肉’,能够快速现实商业利益的东西,很多公司涌进市场。”

不过,拿订餐订票为例,其实很多餐厅或是机票都有免费客服电话,为什么大家还是更愿意在APP上划拉几下订餐,而不愿意打电话呢?因为语音交互在这时候效率是很低的,人类阅读文字、图片的速度比听语音快上不少,用APP三分钟可以解决,语音则可能需要花上五分钟。

而且,微软的野心远不止于此。

周力说,这种伸手就能摘到的果实确实能立刻赚到钱,但是大公司希望投资更长远的未来。微软希望成为人工智能里引领行业的巨头,打造对话即平台的新一代操作系统。

他们希望把小冰打造得更像“人”,坚持走和人类进行对话、进行更长的对话、进行更具备EQ的对话。

未来在你疲惫时,小冰会像个朋友一样跟你聊天、一起吐槽老板、或者建议你考不考虑请假旅个游、查了下去巴厘岛的机票便宜而且不用签证等等……不仅能完成你提出的任务、疏解你的心情,还能发掘你的需求,帮你创造出新的东西。

这一天离我们还有些远,周力认为,如果三年前第一代小冰能给到30分的话,现在的小冰大概能打到55分,但需要7、80分才是人机交互真正爆发的节点——我们可能还需要再等个两、三年。

结语:

作为微软三条主要人工智能产品线(Infuse AI、Bing和小娜、小冰)之一,小冰走的路线与其他两项很不一样,跟市面上的大多数虚拟助手也不一样。

虽然我们看到很多从微软亚洲研究院出走的技术界大牛,但是微软亚洲研究院本身的人员和研究技术依然是不容小觑的。“抢跑”三年的微软小冰,在用户对话上积累的数据可能只有Siri和Alexa可以企及。再加上微软作为一家跨国大公司,对内部项目在金钱及资源方面有着令人艳羡的宽容程度,小冰团队的学术成长环境可以称得上是得天独厚了。

不过,目前的产学研界的自然语言技术还在“黎明前的摸索”阶段,需要攻克的技术难点不少,小冰虽然有着一定的领先优势,但现在还只能算是个55分的“邻家小女孩”。另一方面,无论是陪聊天还是唱歌、写诗,小冰的商业价值至今仍不算特别明朗,未来是否会成长为人机交互的新平台,我们拭目以待。

相关资讯

最新热门游戏

微软资讯推荐

- 1 微软重新定义的学生本值得买吗?文化的差异是个问题

- 2 微软首席执行官:隐私是一项需要被保护的人权

- 3 华为余承东:Win10系统已经OK了,现在可以继续欢呼

- 4Windows 10最新预览版“任务管理器”增加GPU性能追踪

- 5免费升级win10倒计时还有4天,现在不升级将来要多花800块

- 6微软又开始抛弃用户: 仅11款WP手机支持创意者更新(开放和封闭, 微软对于这个问题有自己的理解)

- 7Wintel联盟要掰? 微软展示首款Win 10-ARM笔记本

- 8电脑要卖不出去?戴尔、微软、惠普都急了

- 9微软将在10月份停止对Win10 1511的支持

- 10最强游戏机来了! 微软Xbox One X国行过审 期待不?