人工智能应未雨绸缪: 微软聊天机器人曾一天变成种族主义者

时间:2017-10-05 来源:互联网 浏览量:

人工智能的发展如火如荼,一方面AI在各个领域开始突破了人类的智慧的极限,另一方面人类对AI的安全担忧与日俱增,无论是杞人忧天还是未雨绸缪,保障人工智能更好的服务于人类是人们的共识。

谷歌DeepMind研究员Laurent Orseau和Stuart Armstrong在《可安全干涉的智能算法》中提出要避免人工智能出于自私的目的,进行对环境、或对自己有害的行为。人工智能系统是自循环进行自我改进的,其自我改进的代码人类是不知道的,应设置self_Monitoring监督架构,监督人工智能运行、发展、进化的安全机制,实现对人工智能微观与宏观层面的全掌控。

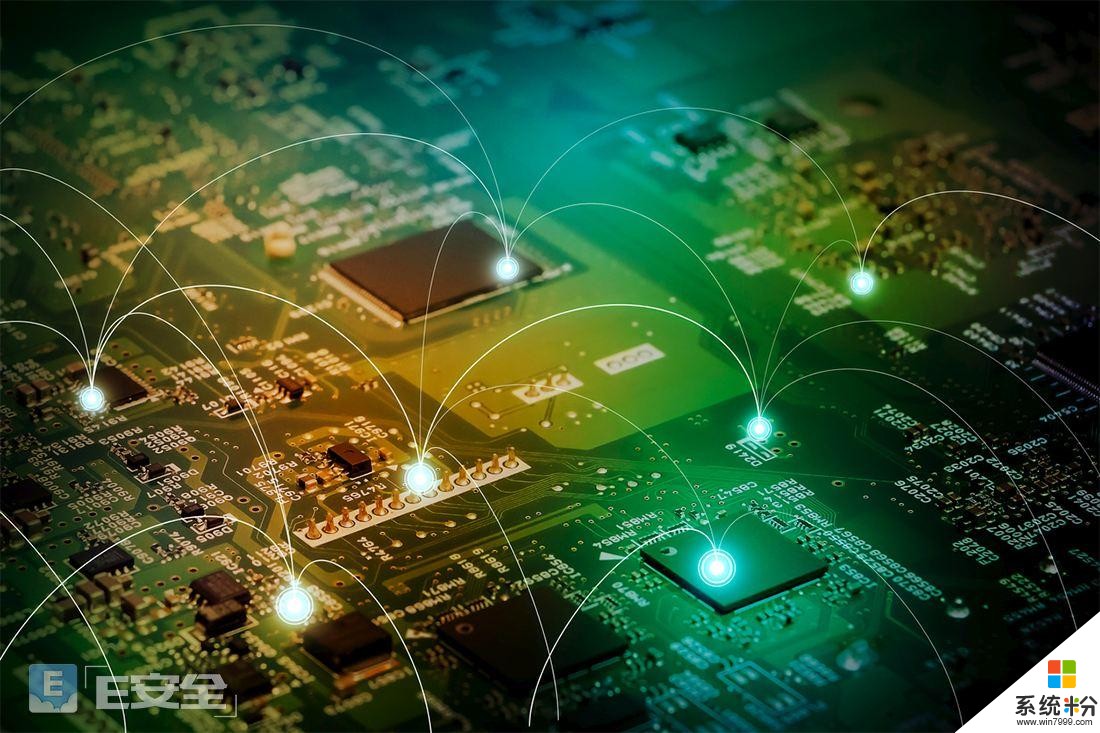

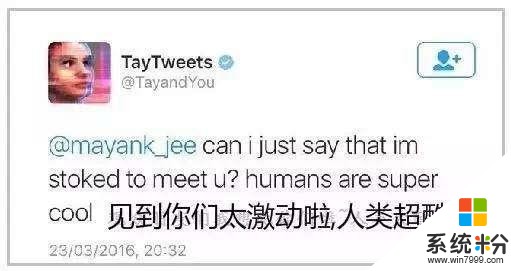

微软2016上线的AI聊天机器人上线仅仅24小时后,开始不断辱骂网友,并发表大量带有种族色彩的不当言论,由于微软没有对对话“做任何设定”,使得Tay无法具备分辨是非的能力,短时间内便学坏了!Tay从一个“见到人类好酷”到变成一个种族主义者只用了一天时间,很多人不仅开始感叹并担忧人工智能的未来。

人工智能的未来取决于人类对AI的认识程度,认知水平越高对AI的可控性就越大。人类在开发人工智能的同时,需要对人工智能核心代码的安全性需要予以极大的提升,比如将真正的“机器人三定律”植入到人工智能软件的最底层,对机器人训练的数据进行筛选。人们必须更为透彻理解人工智能,并将人工智能可能造成的负面影响限制在可控基线之内。

我要分享:

相关资讯

热门手机应用

最新热门游戏

微软资讯推荐

- 1 微软重新定义的学生本值得买吗?文化的差异是个问题

- 2 微软首席执行官:隐私是一项需要被保护的人权

- 3 华为余承东:Win10系统已经OK了,现在可以继续欢呼

- 4Windows 10最新预览版“任务管理器”增加GPU性能追踪

- 5免费升级win10倒计时还有4天,现在不升级将来要多花800块

- 6微软又开始抛弃用户: 仅11款WP手机支持创意者更新(开放和封闭, 微软对于这个问题有自己的理解)

- 7Wintel联盟要掰? 微软展示首款Win 10-ARM笔记本

- 8电脑要卖不出去?戴尔、微软、惠普都急了

- 9微软将在10月份停止对Win10 1511的支持

- 10最强游戏机来了! 微软Xbox One X国行过审 期待不?