AI芯片国际4股势力,中国芯靠什么弯道超车?

时间:2018-08-31 来源:互联网 浏览量:

要说如今科技圈什么最火,人工智能肯定是其中之一。谷歌、微软、亚马逊、IBM等全球科技巨头才纷纷投入巨资加速人工智能核心芯片的研发,目标在于抢占新计算时代的战略制高点,掌控人工智能时代主导权。

人工智能包括了从芯片器件、计算设备、程序平台到大数据、功能层、应用端等复杂结构。在这样一个产业生态中,一些有实力的国际互联网巨头,如谷歌、Facebook、亚马逊、百度以及苹果公司,是以垂直整合模式介入的,它们成为最有实力的玩家。英特尔、高通、英伟达等国际芯片龙头则以整合芯片、计算以及部分软件程序为发展策略,力求扮演硬件设施平台供应商的角色。一些有实力的终端品牌公司,包括近年来得到快速发展的中国智能手机厂商,如华为、小米、VIVO、OPPO,希望AI成为终端设备供应商。

由于具有得天独厚的技术和应用优势,英伟达和 谷歌 几乎占据了 人工智能 处理领域80%的市场份额,而且在谷歌宣布其Cloud TPU开放服务和英伟达推出自动驾驶处理器Xavier之后,这一份额占比在2018年有望进一步扩大。其他厂商,如英特尔、特斯拉、ARM、IBM以及Cadence等,也在人工智能处理器领域占有一席之地。

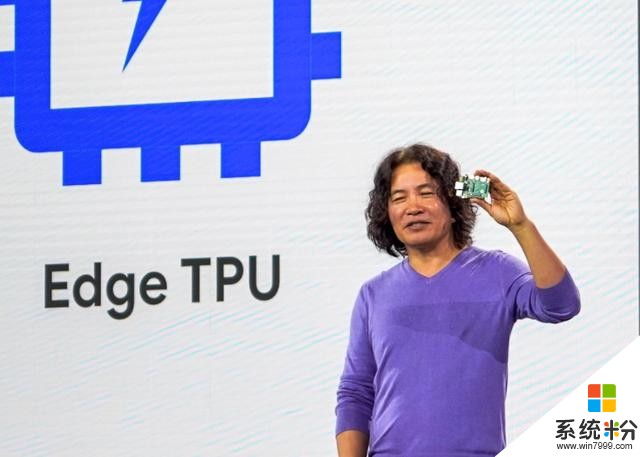

市场巨头地位MVP——英伟达

在人工智能领域,英伟达可以说是目前涉及面最广、市场份额最大的公司,旗下产品线遍布自动驾驶汽车、高性能计算、机器人、医疗保健、云计算、游戏视频等众多领域。凭借通用的GPU单元,专门的TensorRT加速器,强劲的矩阵运算性能加上对其他算法的兼顾,英伟达不仅能用GPU满足AI构建的训练需求,还能用TeslaRT用来部署,很好实现AI构建。所以英伟达也率先成了这一波AI热潮的最大受益者。

产学研优秀课代表——谷歌

如果你只是知道谷歌的AlphaGo、无人驾驶和TPU等这些人工智能相关的产品,那么你还应该知道这些产品背后的技术大牛们:谷歌传奇芯片工程师Jeff Dean、谷歌云计算团队首席科学家、斯坦福大学 AI 实验室主管李飞飞、Alphabet董事长John Hennessy和谷歌杰出工程师David Patterson。

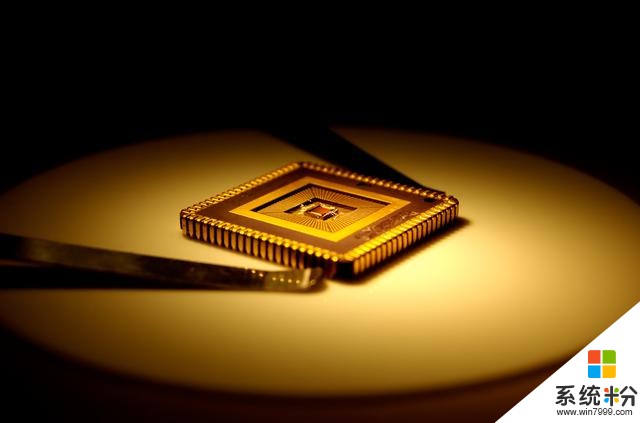

2016年5月的谷歌I/O大会,谷歌首次公布了自主设计的TPU,2017年谷歌I/O大会,谷歌宣布正式推出第二代TPU处理器,在今年的Google I/0 2018大会上,谷歌发布了新一代TPU处理器——TPU 3.0。TPU 3.0的性能相比目前的TPU 2.0有8倍提升,可达10亿亿次,计算规模堪比TOP500超算冠军,所以散热要求也很高,谷歌直接上了水冷系统。

TPU全名为Tensor Processing Unit,是谷歌研发的一种神经网络训练的处理器,主要用于深度学习、AI运算。在7月份的Next 云端大会,谷歌又发布了 Edge TPU 芯片抢攻边缘计算市场。虽然都是 TPU,但边缘计算用的版本与训练机器学习的 Cloud TPU 不同,是专门用来处理AI预测部分的微型芯片。Edge TPU可以自己运行计算,而不需要与多台强大计算机相连,因此应用程序可以更快、更可靠地工作。它们可以在传感器或网关设备中与标准芯片或微控制器共同处理AI工作。

计算机视觉领域的打野专家——英特尔

英特尔作为世界上最大的计算机芯片制造商,近年来一直在寻求计算机以外的市场,其中人工智能芯片争夺成为英特尔的核心战略之一。为了加强在人工智能芯片领域的实力,不仅以167亿美元收购FPGA生产商Altera公司,还以153亿美元收购自动驾驶技术公司Mobileye,以及机器视觉公司Movidius和为自动驾驶汽车芯片提供安全工具的公司Yogitech,背后凸显这家在PC时代处于核心位置的巨头面向未来的积极转型。

不可忽视的力量,辅助上分——学术界

比利时鲁汶大学的Bert Moons等在2017年顶级会议IEEE ISSCC上面提出了能效比高达10.0TOPs/W的针对卷积神经网络加速的芯片ENVISION,该芯片采用28nm FD-SOI技术。

韩国科学技术院K AI ST的Dongjoo Shin等人在ISSCC2017上提出了一个针对CNN和RNN结构可配置的加速器单元DNPU,除了包含一个RISC核之外,还包括了一个针对卷积层操作的计算阵列CP和一个针对全连接层RNN-LSTM操作的计算阵列FRP,相比于鲁汶大学的Envision,DNPU支持CNN和RNN结构,能效比高达8.1TOPS/W。该芯片采用了65nm CMOS工艺。

中国芯片路在何方

目前为止整个AI产业依然受到缺少“杀手级”应用的困扰。如果去除智能驾驶、智能汽车、智能监控、人脸识别、语音识别少数几个应用市场,我们就很难再找到AI的典型应用场景了,特别是缺少与人们工作生活密切相关,又非AI支持不可的应用市场。

目前很难谈在终端 AI 芯片上的新机遇,因为大家都才刚刚起步,包括资本市场才刚刚进入没有多久。尤其是初创型的 AI 芯片公司,一定要迅速做好软件生态系统的布局,否则很容易就被大浪淘沙。对于深度学习的软件开发人员,他们无需学习在 AI 芯片上是如何编程和优化,利用我们的工具就可以自动产生相应的跨平台的代码。