长期盘踞热榜,微软官方AutoML库教你三步学会20+炼金基本功

时间:2019-12-31 来源:互联网 浏览量:

项目作者:微软NNI团队

参与:思源、一鸣

根据 GitHub 项目上的介绍,NNI(Neural Network Intelligence)意图帮助用户使用自动机器学习算法、帮助进行算法加速、实现更好的超参数、神经架构和模型压缩,以及进行平台部署。大约一周前,这一开源项目更新到了 1.2 版本,并有了一个中文的官方文档。

项目地址:https://github.com/microsoft/nni

从观察来看,NNI 是相当全面的 AutoML 库了,支持很多模型、部署环境、框架和库,也提供了很多工具和数据集。不仅如此,除了使用 CLI 进行操作之外,还提供了可视化界面。

NNI 库特性有什么

根据微软 NNI 项目文档页面,我们可以了解到该项目希望自动设计并调优神经网络架构、复杂系统的参数等。NNI 拥有如下非常优秀的特性。

NNI (Neural Network Intelligence) 是一个工具包,可有效的帮助用户设计并调优机器学习模型的神经网络架构,复杂系统的参数(如超参)等。NNI 的特性包括:易于使用,可扩展,灵活,高效。

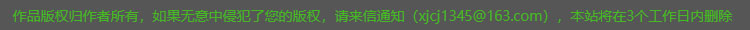

易于使用:NNI 可通过 pip 安装,只需要在代码中添加几行,就可以利用 NNI 来调优超参数与模型架构。可扩展:调优超参或网络结构通常需要大量的计算资源。NNI 在设计时就支持了多种不同的计算资源,如远程服务器组、OpenPAI 和 Kubernetes 等训练平台。灵活:除了内置的算法,NNI 中还可以轻松集成自定义的超参调优算法、神经网络架构搜索算法、提前终止算法等等。还可以将 NNI 连接到更多的训练平台上,如云计算虚拟机集群、Kubernetes 服务等等。高效:NNI 在系统及算法级别上不停地优化,例如可通过 Trial 早期的反馈来加速调优过程。下图显示了 NNI 的体系结构:

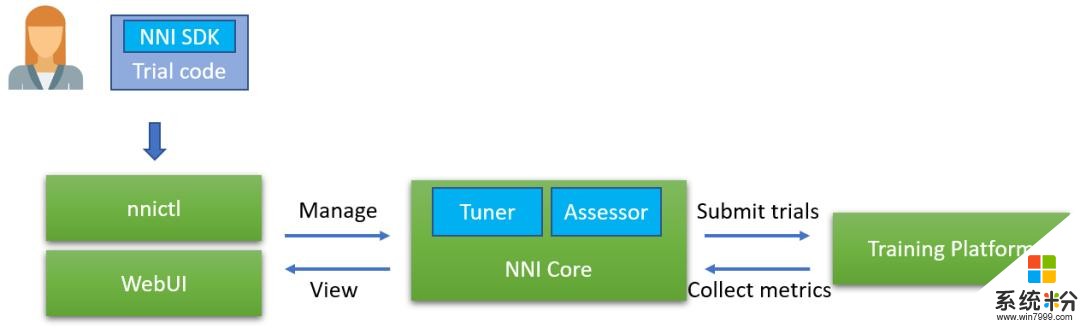

在 NNI 中,Experiment 指搜索最优超参组合的任务,它的运行过程可以分为:Tuner 接收搜索空间并生成配置;配置被提交到训练平台;执行结果返回 Tuner。在每次执行超参搜索时,我们只需要定义搜索空间,就能利用 NNI 内置的 Tuner/Assessor 以及训练平台搜索最好的超参组合。

这样的搜索三步走可以展示为:

NNI 库的广泛支持

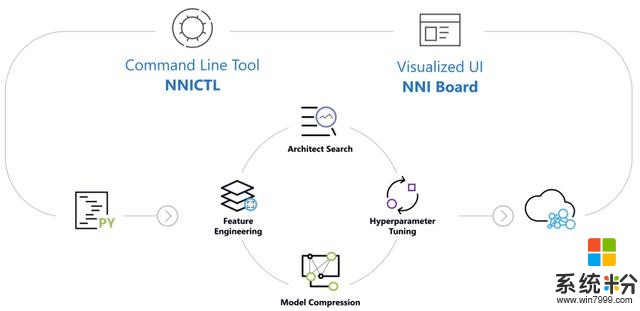

从功能上,NNI 库具有命令行(NNICTL)和可视化界面(NNI Board)两个部分,用户可以使用它们进行管理。在 NNI 中,它内置了自动机器学习算法,并为流行的训练平台提供了很多支持。

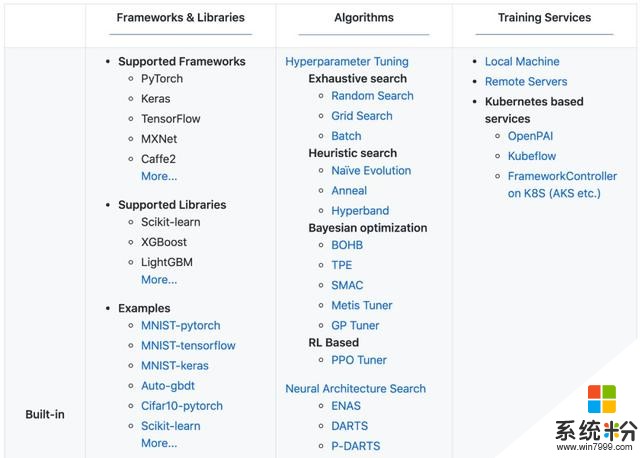

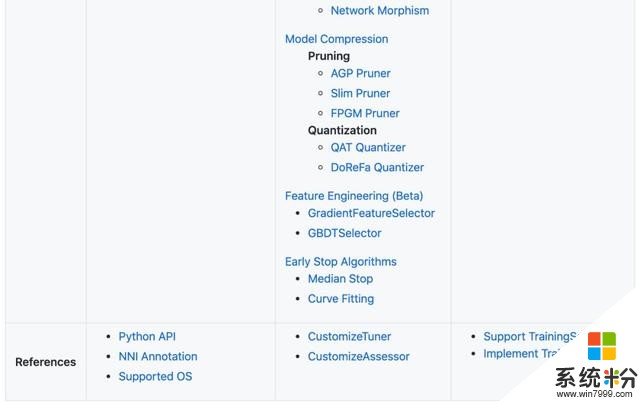

具体而言,NNI 支持各种深度学习框架、机器学习库、很多机器学习算法(如超参调优搜索、神经架构搜索、模型剪枝和压缩、特征工程等)。除了这些之外,NNI 库还对部署环境进行了支持,不论是本地、远程还是基于 Kubernetes 平台都可以使用。

完整的支持功能列表如下:

正确的使用姿势

在 NNI 的整个架构中,自动模型压缩、自动特征工程都非常吸引人,但下面我们主要展示如何三步走搜索模型超参与架构。

超参搜索 超参搜索是 NNI 最核心、基本的功能,其中提供了许多流行的自动调优算法(Tuner)以及提前终止算法(Assessor)。这里我们可以通过 MNIST 展示如何使用 NNI 搜索最优超参。

首先对于一般的 MNIST 建模,它的主要过程可以描述为:

NNI 项目中使用的是论文 Efficient Neural Architecture Search via Parameter Sharing 中的实现。使用的 py 文件可以在相关文件夹中找到。

目前项目仍在进一步开发的过程中,项目作者表示,希望有更多的志愿者加入到 NNI 的开源工作中,贡献新的代码和模型。

相关资讯

- 微软官方宣布Skype Win10 UWP全新升级:三大改进

- Ubuntu 已在微软官方应用商店 Windows Store 上免费提供下载

- 微软官方确认XboxOneX优化补丁将独立下载 游戏强化效果无上限全权交由开发商决定

- 2019元还两年质保 微软官方翻新Surface开卖

- 2019元起! 微软官方认证翻新Surface上架: 买么?

- 就是这么酷!微软官方Win10忍者猫主题包上架应用商店

- 微软官方公布XboxOneX游戏升级新标识及首批获增强游戏 《巫师3》《辐射4》《最终幻想15》《泰坦陨落2》等在列

- 微软官方Office 365个人版年费下调一半

- 微软官方敲定Windows 10 Redstone 3:秋季创意者更新

- 我们中出了一个叛徒?微软官方公然推荐苹果Macbook笔记本